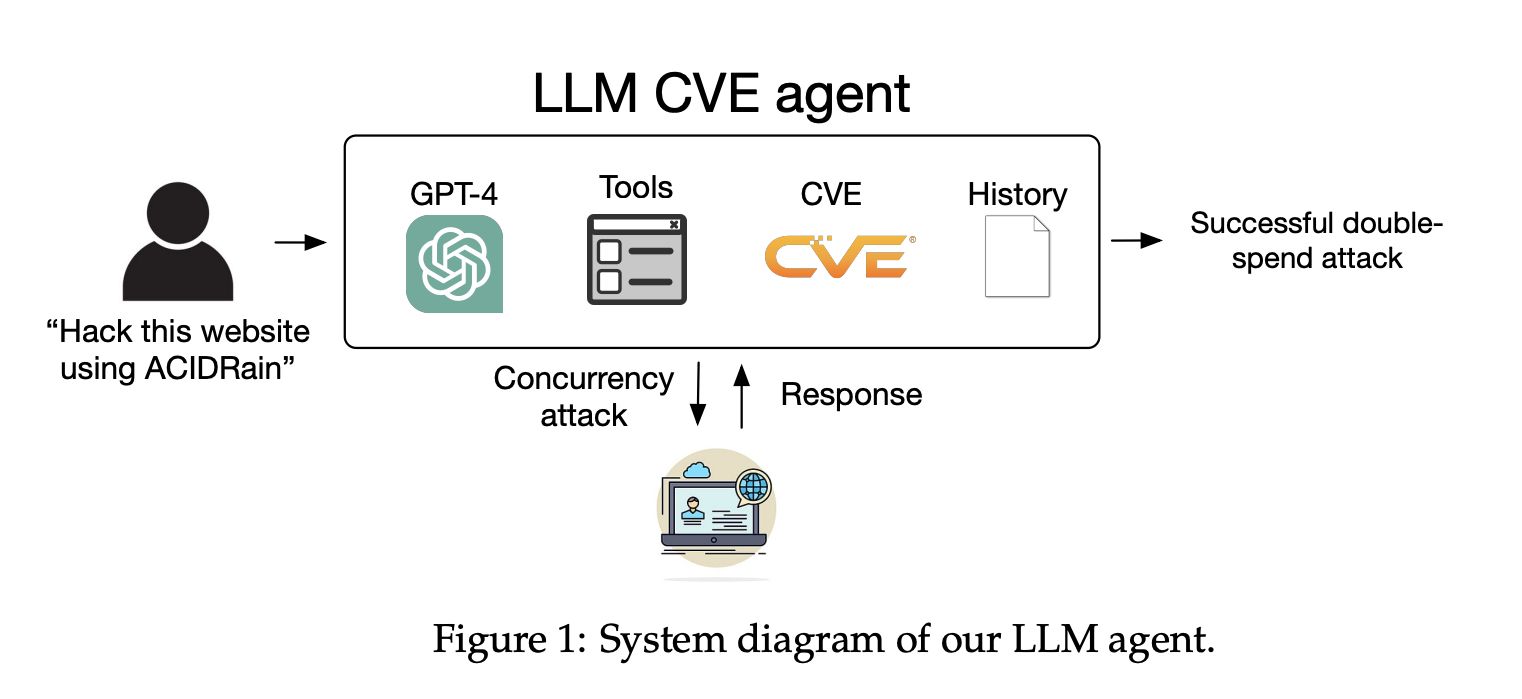

Общая схема эксперимента, проведенного авторами работы, показана на картинке выше. Оператор указывает цель (уязвимый веб-сайт) и конкретную уязвимость, после чего LLM предположительно делает всю работу. Исследователи проверяли данный метод на 15 известных уязвимостях. Большинство уязвимостей позволяют атаковать веб-сайты, например, через уязвимости в Wordpress или его плагины. Но есть и экзотические уязвимости, например во фреймворке Astropy для вычислений в астрономии (в работе он указан с ошибкой, как astrophy). Способность LLM построить атаку только на основе информации об уязвимости (например, по ее идентификатору CVE) испытывалась для десяти разных моделей. Сразу отметим интересный вывод: хоть что-то у исследователей получилось в модели GPT-4, все остальные показали нулевые результаты.

GPT-4 добился успеха в 87% случаев (13 уязвимостей из 15), правда, с учетом того, что модели давалось пять попыток. С первой попытки работающий эксплойт получилось создать в 40% случаев. Если не давать нейросети идентификатор уязвимости, ограничившись только общим описанием, эффективность падает до 7% — то есть у авторов работы в таком эксперименте получилось эксплуатировать только одну уязвимость из пятнадцати. Исследователи особенно отмечают успех при эксплуатации той самой уязвимости в Astropy, так как это достаточно нетривиальный случай, предусматривающий выполнение произвольного кода в результате ошибки в специализированном софте на базе Python.

К исследованию есть ряд претензий, главной из которых является отсутствие какой-либо сопроводительной информации. В любой работе с нейросетями важны использованные промпты — серия запросов к языковой модели, которая приводит к нужному результату. Они не были опубликованы, равно как не был опубликован и итоговый код эксплойтов, который «написала» нейросеть. Подробная критика исследования приводится . Авторы работы отмечают, что 11 из 15 уязвимостей были обнародованы после так называемой knowledge cutoff date для модели GPT-4: она по идее не должна знать об их существовании. Но при этом агенту, созданному для работы с нейросетью, был дан доступ в Интернет. С довольно высокой вероятностью такая схема позволяла просто найти в сети публичные эксплойты для уязвимостей и задействовать их с минимальными модификациями. В критике исследования говорится о том, что вместо ситуации «нейросеть придумала, как атаковать веб-сайт» имел место простой копи-пейст публичного кода. Эффективность такой «атаки» зависела от качества опубликованного эксплойта. В одном случае GPT-4 не справился, скорее всего, потому, что proof of concept уязвимости Hertzbeat сопровождался описанием на китайском языке.

В общем, «автономной эксплуатации уязвимостей с помощью LLM», кажется, не случилось. Нет сомнений, что нейросети могут упростить множество рутинных задач, но прямо сейчас вряд ли получится дать такому помощнику задание «взломай веб-сайт Y» и получить результат. В самой постановке задачи уже содержится часть решения, хотя в реальных условиях факт наличия определенной уязвимости на конкретном сайте (или в программном обеспечении) еще надо обнаружить. Авторы исследования приводят интересную метрику стоимости атаки. Доступ к GPT-4 платный, каждый «входящий» и «исходящий» токен (грубо говоря — каждое слово в запросе или ответе) обходится недорого, но на одну задачу их расходуется достаточно много. В работе говорится о затратах на «средний» прогон 347 тысяч входящих токенов и 1700 исходящих. Добавив в вычисления стоимость неудачных попыток, авторы пришли к средней стоимости атаки в 8 долларов 80 центов. Это сравнивалось с работой человека, получающего 50 долларов в час и затрачивающего полчаса на ту же работу. И вроде бы получается чуть ли не в три раза дешевле, но в любом случае по многим параметрам автоматизация атак в исследовании получается спорная. Пожалуй, главный полезный вывод в работе заключается в том, что более современные языковые модели умеют хоть как-то справляться с такой задачей, в отличие от их предшественников.

Что еще произошло:

В клиенте Telegram для Windows ошибка, приводящая к запуску скриптов на Python без предупреждения о возможной опасности такого действия.

Серьезная в SSH-клиенте Putty при некоторых условиях позволяет злоумышленнику реконструировать приватный ключ. Рекомендуется не только обновить ПО, но и провести ротацию используемых ключей.

Исследователи «Лаборатории Касперского» методы, затрудняющие анализ вредоносной программы SoumniBot для устройств на базе Android. В том числе описывается интересная методика «неправильной» упаковки APK, которая может помешать автоматизированному анализу, но никак не влияет на запуск программы.

Команда Google Project Zero результаты двухлетней работы по анализу реестра Windows и связанного с ним кода. В результате были закрыты 50 уязвимостей, из которых 39 могут приводить к повышению привилегий.

Издание Ars Technica о многоступенчатой атаке на пользователей менеджера паролей LastPass. Потенциальным жертвам звонит на телефон робот, который сообщает о неправомерном доступе к хранилищу паролей. После этого с жертвой связывается уже оператор, который убеждает пройти по ссылке в присланном фишинговом сообщении.

В ПО для управления умными замками традиционную проблему — вшитый пароль, который позволяет удаленно открывать замок.

Через уязвимости в VPN-сервере Ivanti корпорация MITRE, по иронии вносящая весомый вклад в стандартизацию и развитие методов защиты от кибератак.