Последние авиакатастрофы в России напомнили мне давнее исследование министерства транспорта США (может и у нас такое есть, но с публичностью таких документов в США на несколько порядков получше будет) "Система классификации и анализа человеческого фактора" (The Human Factors Analysis and Classification System - HFACS).

Разработанное еще в 2000-м году это исследование начинается с того, что постулирует следайющий факт - по статистике от 70 до 80% всех авиационных инцидентов в гражданской и военной авиации происходит по вине человека. При этом причины этих инцидентов никак не классифицированы. В результате при возникновении инцидента сложно идентифицировать проблему, понять ее причины и предотвратить повтор неприятных событий. Собственно для решения этой задачи и была разработана система классификации HFACS.

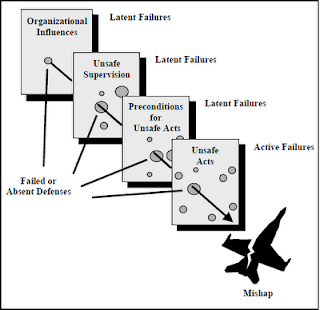

Данная система использует лучшее, что было на тот момент в области исследования человеческого фактора. Это и известная с начала 90-х годов модель совершения человеческих ошибок "Швейцарский сыр".

Это и "Таксономия небезопасных операций" Шеппеля и Вигманна и ряд других. В результате появляется HFACS. По данной модели существует 4 уровня отказов/сбоев/ошибок/проблем, приводящих к инцидентам - небезопасное действие, предпосылки к небезопасным действиям, плохой надзор и влияния организации. При этом каждый уровень разбивается на подуровни и составляется полная таксономия всех "человеческих факторов".

Но и не этим хороша HFACS. Для каждого уровня существуют и более детальные списки причин, приведших к инцидентам. Вот как выглядит неполный список причин для влияния организации:

Можно заметить, что даже в этот неполный список попали все ключевые источники проблем - алкоголь, наркотики, плохой рекрутинг персонала, давление времени, урезание расходов и т.д.

Собственно к чему я начал рассказ про авиационные инциденты? Да к тому, что в ИБ HFACS можно применять практически без изменений. Эта классификация прекрасно объясняет почему происходят инциденты информационной безопасности. Она может быть использована при моделировании угроз. Спектр ее применений огромен. Главное, чтобы ее применяли...

Разработанное еще в 2000-м году это исследование начинается с того, что постулирует следайющий факт - по статистике от 70 до 80% всех авиационных инцидентов в гражданской и военной авиации происходит по вине человека. При этом причины этих инцидентов никак не классифицированы. В результате при возникновении инцидента сложно идентифицировать проблему, понять ее причины и предотвратить повтор неприятных событий. Собственно для решения этой задачи и была разработана система классификации HFACS.

Данная система использует лучшее, что было на тот момент в области исследования человеческого фактора. Это и известная с начала 90-х годов модель совершения человеческих ошибок "Швейцарский сыр".

Это и "Таксономия небезопасных операций" Шеппеля и Вигманна и ряд других. В результате появляется HFACS. По данной модели существует 4 уровня отказов/сбоев/ошибок/проблем, приводящих к инцидентам - небезопасное действие, предпосылки к небезопасным действиям, плохой надзор и влияния организации. При этом каждый уровень разбивается на подуровни и составляется полная таксономия всех "человеческих факторов".

Но и не этим хороша HFACS. Для каждого уровня существуют и более детальные списки причин, приведших к инцидентам. Вот как выглядит неполный список причин для влияния организации:

Можно заметить, что даже в этот неполный список попали все ключевые источники проблем - алкоголь, наркотики, плохой рекрутинг персонала, давление времени, урезание расходов и т.д.

Собственно к чему я начал рассказ про авиационные инциденты? Да к тому, что в ИБ HFACS можно применять практически без изменений. Эта классификация прекрасно объясняет почему происходят инциденты информационной безопасности. Она может быть использована при моделировании угроз. Спектр ее применений огромен. Главное, чтобы ее применяли...