Безопасность информационно-коммуникационных технологий в контексте устойчивого развития социума

В статье рассматриваются вопросы развития человеческого социума в условиях смены финишного, перед 4-й промышленной революцией, технологического уклада, связанного с развитием информационно- коммуникационных технологий (ИКТ) как одного из катализаторов устойчивого прогресса в развитии социальных и производственных отношений современного общества.

В. А. Артамонов, доктор технических наук, профессор, академик МАИТ, Республика Беларусь, рег.в ООН, представительство в РБ – 220012, г. Минск, ул. Сурганова, 6. artamonov@itzashita.ru .

Е. В. Артамонова, кандидат технических наук, член МАИТ, Республика Беларусь, рег.в ООН, пр-во в РБ – 220012, г. Минск, ул. Сурганова, 6. admin@itzashita.ru.

Л. А. Кулак (псевдоним Антония Ильинская), инженер, доктор философии, Авторская Лаборатория Образного Синтеза в составе МИГЭП при МАИТ, член МАИТ, США. anoniyau@yahoo.com.

Введение. Понимая под социумом совокупность человеческих взаимоотношений, которые регулируются определенными нормами и правиламибольшой группы людей, имеющих общие взгляды, морально-нравственные ценности, традиции, историю и культуру, а также одни и те же политические и экономические устои, территорию проживания и общий менталитет, – можно констатировать, что определяющей доминантой такого человеческого социума является его устойчивое развитие. При этом под устойчивым развитием понимается процесс экономических и социальных изменений, при котором эксплуатация природных ресурсов, направление инвестиций, а также ориентация научно-технического развития общества и личности, институциональные изменения согласованы друг с другом и укрепляют нынешний и будущий потенциал для удовлетворения человеческих потребностей и устремлений. Во многом в этом понятии речь идёт о развитии научно-технического прогресса для обеспечения качества жизни людей.

Одна из характерных особенностей современного этапа мирового научно-технического прогресса связана с глобальной информационной революцией – стремительным развитием и повсеместным внедрением новейших ИКТ. Проникая во все сферы жизнедеятельности государств, ИКТ расширяют возможности развития международного сотрудничества, формируют глобальное информационное и киберпространство, в котором информация приобретает свойства ценнейшего элемента национального достояния, его стратегического ресурса. Но вместе с этим, прогресс в области ИКТ несёт потенциальные угрозы для устойчивого развития человечества. Об этих угрозах и мерах им противодействия давайте поговорим подробнее.

Основная часть. Глобальным трендом развития современного человеческого социума становятся такие инновации VI–го технологического уклада развития общественных отношений, как цифровая экономика, электронное правительство, криптовалюта, искусственный интеллект, беспилотный транспорт и др.

Вместе с тем становится очевидным, что наряду с положительными моментами такого процесса создается и реальная угроза использования достижений в информационной сфере (кибероружие) в целях, не совместимых с задачами поддержания мировой стабильности и безопасности, соблюдения принципов суверенного равенства государств, мирного урегулирования споров и конфликтов, неприменения силы, невмешательства во внутренние дела, уважения прав и свобод человека.

Таким образом, исходя из вышесказанного, безопасность общества в контексте устойчивого развития человеческого социума можно разделить на три большие группы: личную, общественную и государственную.

Личная безопасность – состояние защищённости человека от психологического, физического или иного насильственного посягательства.

Общественная безопасность – способность социальных институтов общества обеспечить его устойчивое, независимое, свободное и самостоятельное развитие и реализацию выбранного пути. Определяется уровнем и состоянием общественных отношений.

Государственная безопасность – система общественных и государственных гарантий, защищающих основные ценности, духовные и материальные источники жизнедеятельности, гражданских прав и свобод человека, защиту суверенитета, территориальной целостности и независимости от внешних и внутренних угроз.

Давайте рассмотрим коротко, как же соотносится безопасность ИКТ и исходящие от них угрозы на вышеупомянутые безопасности человеческого социума.

В основе безопасности ИКТ лежит деятельность по защите информации – обеспечению её конфиденциальности, доступности и целостности. В совокупности эти три ключевых принципа информационной безопасности (ИБ) именуются триадой CIA.

Confidentiality (с англ. – «конфиденциальность») – свойство информации быть недоступной или закрытой для неавторизованных лиц, сущностей или процессов;

Integrity (с англ. – «целостность») – свойство сохранения правильности и полноты активов;

Availability (с англ. – «доступность») – свойство быть доступным и готовым к использованию по запросу авторизованного субъекта.

Здесь и далее под информационной безопасностью мы будем понимать защищённость информации и поддерживающей инфраструктуры от случайных или преднамеренных воздействий естественного или искусственного характера, которые могут нанести неприемлемый ущерб субъектам информационных отношений будь то человек, общество или государство.

При этом, важно помнить основополагающую парадигму ИБ – безопасность это не продукт, а процесс постоянный и непрерывный состоящий в состязательности потенциала нарушителя и системы защиты.

Кроме того, отдельной темой являются ситуации с нарушениями ИБ на объектах критической информационной инфраструктуры (КИИ), а также недопущению какой-либо компрометации в критической ситуации. К таким ситуациям относятся компьютерные атаки на критически важные объекты социальной и государственной инфраструктуры, природные, техногенные и социальные катастрофы, компьютерные сбои, физическое похищение и тому подобные угрозы.

Трансформация промышленных революций. Мир стоит на пороге четвёртой промышленной революции. И этот непреложный факт уже не вызывает практически никаких сомнений. Среди учёных теоретической экономики есть разные определения или признаки той или иной промышленной революции. Не вдаваясь в анализ строгости и достоверности классификации остановимся на классической и в тоже время рациональной – немецкой.

По немецкой классификации Индустрия 1.0 сформировалась при широком распространении ткацкого станка и паровой машины в конце XVIII века.

Индустрия 2.0 — в начале ХХ века при переходе к конвейеру.

Индустрия 3.0 в конце 70-х прошлого века вследствие компьютеризации и распространения станков с числовым программным управлением (ЧПУ).

Индустрия 4.0 или четвертая промышленная революция, сегодня пока только набирает обороты и заключается в развитии ИКТ, робототехники, ИИ, МО, дальнейшей цифровизации экономики, внедрении концепции «электронного правительства», электронных денег (криптовалюты), автоматизации производства и сферы услуг, расширении применения безлюдных технологий и транспорта, интернета вещей (IoT), развитию центров обработки данных (ЦОД) и «облачных вычислений».

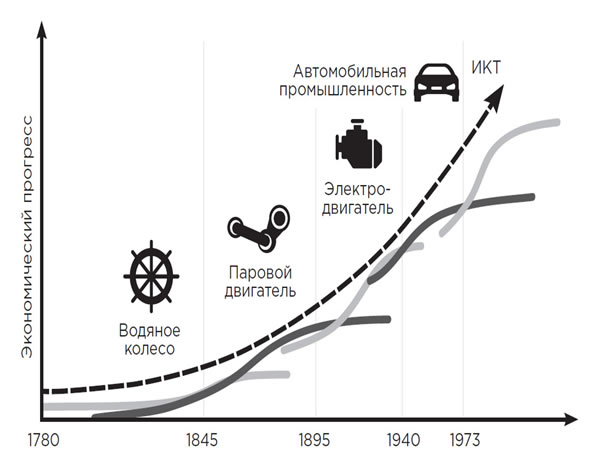

Для каждого периода времени развития человечества характерна своя трансформация, которую можно описать как некую совокупность промышленных технологий позволяющих создать определенный качественный скачок в росте производительности труда. Это определение вписывается в широко принятую концепцию смены технологических укладов, где трансформация на базе ИКТ является одним из этапов (рис.1). Кривая изменения экономического прогресса (роста производительности труда) отображается в виде S-образной кривой с периодами зарождения (медленного роста), активного роста и зрелости (замедления роста). Совокупность технологических инноваций приводит к смене одного уклада на другой. Каждый из этапов экономического прогресса на рисунке 1 (включая стадию ИКТ) можно разделить на более мелкие части, и в каждой выделить свои трансформирующие технологии. Разные специалисты предлагают свою периодизацию. В частности, по одной из них (рис.2) предлагает пять этапов, включая TCP/IP и заканчивая облачными технологиями. Выбирая более короткий период, например, эволюцию web-технологий, внутри него также можно выделить свои периоды (рис.3).

Рис. 1. Трансформирующие технологии и технологические уклады. Источник: M. Hilbert, University of California.

Технологическая сингулярность. При рассмотрении сути четвёртой промышленной революции уместно рассмотреть концепцию технологической сингулярности.

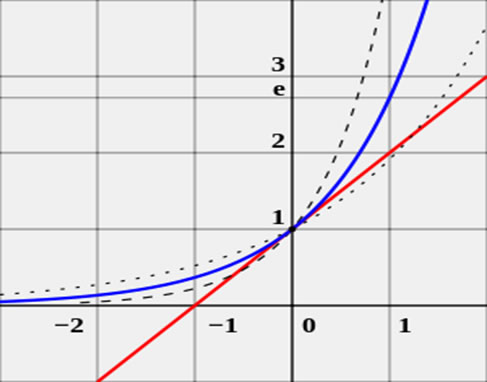

Технологическая сингулярность – это гипотетический момент в будущем, когда технологическое развитие станет настолько стремительным, что экспоненциальный график (рис.4) технического прогресса станет практически вертикальным. Осмысление экспоненциальных технологий потребовало некоторого времени, прежде чем они получили полное признание всего за несколько лет. Этой тенденции следуют самые разные области, такие как, например, искусственный интеллект и машинное обучение в качестве одной из ветвей развития ИКТ, робототехника, здравоохранение, электро- и самоуправляемые автомобили, образование, трёхмерное печатание, промышленность и сельское хозяйство [1,2,3].

Добро пожаловать в 4-ю промышленную революцию. Добро пожаловать в Экспоненциальный Век. Эта концепция была предложена Вернором Винжем [1], который предположил, что если мы сумеем избежать гибели цивилизации до этого, то сингулярность произойдет из-за прогресса в области искусственного интеллекта, интеграции человека с ИКТ или других методов увеличения разума. Усиление разума, по мнению Винжа, в какой-то момент приведет к положительной обратной связи: более разумные системы могут создать еще более разумные и сделать это быстрее, чем первоначальные их конструкторы – люди. Эта положительная обратная связь скорее всего окажется столь сильной, что в течение очень короткого промежутка времени (месяцы, дни или даже всего лишь часы) мир преобразится больше, чем мы можем это представить, и внезапно окажется населен сверхразумными созданиями.

По мнениям некоторых учёных – футурологов [2,3] и того же Винжа, придерживающихся концепции сингулярности, она должна наступить около 2030 года и даже по самому пессимистическому сценарию не позднее середины этого века, т.е. в 2050 году.

Если проэкстраполировать закон Мура (наблюдение, сделанное в 1965 году Гордоном Муром, одним из основателей корпорации Intel, что количество транзисторов на квадратный дюйм в интегральных схемах увеличивается двукратно каждые два года, начиная с изобретения интегральных схем), окажется, что примерно в то же время вычислительная мощность компьютеров сравнится с головным мозгом человека. Сторонники теории технологической сингулярности считают, что если возникнет принципиально отличный от человеческого разум (постчеловек), дальнейшую судьбу цивилизации невозможно предсказать, опираясь на человеческую логику. С понятием сингулярности часто связывают идею о невозможности предсказать, что будет после нее. Вопрос предсказуемости важен, поскольку, не имея возможности предсказать хотя бы некоторые последствия наших действий, нет никакого смысла в том, чтобы пытаться направить развитие в желательном направлении.

Рис. 2. Этапы в развитии ИКТ. Источник: Сеиф Хардиди «История эволюции интернета» [4].

Постчеловеческий мир, который в результате появится, возможно, будет столь чуждым для нас, что сейчас мы не можем знать о нем абсолютно ничего. Единственным исключением могут быть фундаментальные законы природы, но даже тут иногда допускается существование еще не открытых законов (у нас пока нет теории квантовой гравитации) или не до конца понятых следствий из известных законов (путешествия через пространственные «дыры», рождение "вселенных-карликов", путешествия во времени и т.п.), с помощью которых постлюди смогут делать то, что мы привыкли считать физически невозможным.

Угрозы искусственного интеллекта. Человечество стоит на пороге не только технологического, но и философского кризиса, считает историк Юваль Харари, автор книги «Sapiens: Краткая история человечества» [4]. Новые технологии формируют новые формы антиутопии. И общество пока не понимает, как адаптироваться к меняющейся реальности.

Харари вывел формулу предстоящего глобального кризиса:

В данном случае B – это познания в биологии, C – это вычислительная мощность, а D – это данные. Если помножить их друг на друга, появится возможность взламывать людей (HH – hack humans).

Под взломом исследователь подразумевает возможность управлять человеком на глубинном уровне, то есть контролировать его желания и стремления. Харари опасается, что правительства и корпорации скоро изучат людей настолько, что смогут с легкостью регулировать их мысли.

Технологии отдаленно будут напоминать таргетированную рекламу, только их действие будет более точным, а эффект – стопроцентным.

Ранее исследователь отмечал, что в сложившихся обстоятельствах привычные философские концепции отмирают. Это касается свободы воли и свободы выбора. Люди ошибочно полагают, что контролируют ситуацию, но на самом деле это не так.

Главное следствие масштабного внедрения искусственного интеллекта – это утрата человеком автономии и авторитета. При этом ИИ не обязательно выходить на один интеллектуальный уровень с людьми и обладать сознанием. Алгоритмам МО достаточно будет изучить личность досконально, чтобы найти самую слабую точку и запустить процесс манипуляций.

Рис. 3. Этапы в развитии web-технологий. Источник: Сеиф Хардиди «История эволюции интернета» [4].

Рис. 4. Экспоненциальная функция развития прогресса человечества. Примечанние: Выполнено с помощью формул и функций Excel.

, где e – число Эйлера (e = 2,718…)

График экспоненты: (синий).

Касательная (красным) в нуле у функции : наклонена на 45o .

Рядом для примера показаны: : (точками) и (пунктиром).

Общество подвержено взлому на всех уровнях, но больше всего Харари пугает биологический: «Эксперты по ИИ могут общаться с философами. С историками – да, пожалуйста. С литературными критиками – замечательно. Но меня пугает их общение с биологами», – признал он в интервью изданию Wired. Тем не менее, исследователь подчеркивает, что ИИ означает и массу преимуществ. Особенно это касается медицины. Харари подчеркивает, что никто не станет препятствовать внедрению технологии – ведь она способна принести столько пользы людям.

Распространение ИИ в комплекте с биотехнологическими открытиями породит два возможных сценария антиутопии.

Первый: надзор-капитализм – даст алгоритмам полную власть над людьми. Машинный интеллект и МО решат за нас, где жить, работать, с кем встречаться и за кого голосовать.

Второй: предполагает: укрепление тоталитаризма и диктатуры, при котором каждый житель Земли – это объект непрерывной слежки. Особую роль в этом процессе сыграют биометрические и видео - системы, которые не дадут гражданину скрыться от всевидящего ока государства.

Историк подчеркивает: люди могут даже не заметить, как оказались во власти ИИ и МО. Большинство не сможет понять, как работают механизмы алгоритмов и как именно нами манипулируют. Человечество привыкло к традиционным формам объяснения и повествования, но машинный интеллект работает со статистическими данными и оперирует другими понятиями.

Харари считает, что чрезмерное усложнение систем – одна из главных актуальных проблем. Из-за этого, например, ученым все сложнее объяснять свои теории и доносить до аудитории суть открытий.

Важный побочный эффект этого – расцвет теорий заговора. По этой причине сейчас возникает все больше антиглобалистов и тех, кто не верит в глобальное потепление. То же касается и сферы финансов – с каждым годом она усложняется, и некоторые концепции можно объяснить, только если потратить 10 лет на изучение экономики и математики. «В этом тоже выражается философский кризис», – отмечает Харари.

Он также считает, что сегодня человек борется не с отдельными людьми, а с государствами и корпорациями. Перед лицом таких мощных соперников шансов на успех мало. Более того, влияние некоторых стран выходит за географические рамки. Историк обвиняет развитые государства и крупные корпорации в цифровом колониализме. Раньше империи выращивали хлопок в Индии или Египте, потом отправляли сырье в Британию, производили одежду и вновь пересылали ее в Индию или Египет, вытесняя местных производителей.

Сейчас то же самое происходит с данными, продуктами и системами ИКТ. Компании «выкачивают» данные и программы из Бразилии, Индонезии и со всего мира, обрабатывают их в США, Британии, Индии или Китае, а затем создают на их основе продвинутые продукты, которые в итоге распространяют в «колониях».

Математики об искусственном интеллекте. Нарисованная выше учёными – футурологами довольно пессимистическая картина мира после достижения человеческой цивилизацией временной точки технологической сингулярности, скрашивается последними исследованиями учёных – математиков: возможности ИИ оказались небеспредельными [6]. Подобно человеческому разуму, ИИ ограничен парадоксами теории множеств.

До сих пор считалось, что самой фундаментальной проблемой развитии технологий ИИ является необъяснимость принимаемых им решений. В январе 2019 к этой проблеме добавилась еще одна, не менее фундаментальная проблема – принципиальная непредсказуемость, какие задачи ИИ может решить, а какие нет.

На пути триумфального развития технологий машинного обучения, как казалось, способных при наличии большого объема данных превзойти людей в чем угодно – в играх, распознавании, предсказаниях и т.д. – встала первая из 23 проблем, поставленных в докладе Давида Гильберта на международном математическом конгрессе в Париже еще в 1900-м году [7].

Первой в списке этих 23 проблем, решение которых до сих пор считается высшим достижением для математика, была так называемая гипотеза континуума (континуум-гипотеза или 1-я проблема Гильберта), которую выдвинул и пытался решить (но потерпел неудачу) еще сам создатель теории множеств Георг Кантор.

И вот сейчас, на исходе второго десятилетия XXI века гипотеза континуума, будучи примененная к задачам машинного обучения, стала холодным отрезвляющим душем для всех технооптимистов ИИ.

Машинное обучение оказалось не всесильно. И что еще хуже, – в широком спектре сценариев обучаемость ИИ не может быть ни доказана, ни опровергнута.

Первая же научная сенсация 2019 года оказалась совершенно неожиданной. Опубликованная 7-го января в Nature Machine Intelligence статья «Обучаемость может быть неразрешимой» (англ. Learnability can be undecidable) [8] устанавливает предел возможностей машинного обучения – ключевого метода вычислений, на коем стоит весь современный ИИ.

Этот научный вывод столь важен, что журнал Nature сопроводил статью еще двумя популярно её разъясняющими статьями «Недоказуемость приходит в машинное обучение» (англ.Unprovability comes to machine learning) и «Машинное обучение приводит математиков к неразрешимой задаче» (англ. Machine learning leads mathematicians to unsolvable problem).

Суть всех этих статей в следующем. Обнаружены сценарии, в которых невозможно доказать, может ли алгоритм машинного обучения решить конкретную проблему. Этот вывод может иметь огромное значение, как для существующих, так и для будущих алгоритмов обучения. Обучаемость ИИ не может быть ни доказана, ни опровергнута с использованием стандартных аксиом математики, поскольку это связано с парадоксами, открытыми австрийским математиком Гёделем в 1930-х годах [7].

Теория множеств, так или иначе, является основой большинства разделов математики.

Парадоксы – это формально-логические противоречия, которые возникают в теории множеств и формальной логике при сохранении логической правильности рассуждения. Парадоксы возникают тогда, когда два взаимоисключающих (противоречащих) суждения оказываются в равной мере доказуемыми.

С точки зрения математики, вопрос «обучаемости» сводится к тому, сможет ли алгоритм извлечь шаблон из ограниченных данных. Ответ на этот вопрос связан с парадоксом, известным как вышеупомянутая континуум-гипотеза (проблема континуума или 1-я проблема Гильберта) и разрешенным в 1963 г. американским математиком Полом Коэном [7].

Решение оказалось весьма неожиданным: то, что утверждается в гипотезе континуума, нельзя ни доказать, ни опровергнуть, исходя из аксиом теории множеств. Гипотеза континуума логически независима от этих аксиом. Неспециалисту довольно трудно понять, почему утверждения такого рода играют для математики столь большую роль и ставятся на первое место в списке важнейших проблем. Отметим лишь, что на самом деле речь идет о вещах принципиальных и фундаментальных, так как континуум – это, по сути, базовая математическая модель окружающей нас физической, пространственно-временной реальности (частью которой являемся и мы сами), а в математике континуум – еще и синоним совокупности всех действительных чисел, также центрального понятия математики и ее рабочего инструмента.

По сути Гёдель и Коэн доказали, что континуум-гипотеза не может быть доказана ни как истинная, ни как ложная, начиная со стандартных аксиом – утверждений, принятых как истинные для теории множеств, которые обычно принимаются за основу всей математики.

Иными словами, утверждение не может быть ни истинным ни ложным в рамках стандартного математического языка.

Заключение. Проблемам информационной безопасности ИКТ и защищённости человеческого социума от негативного воздействия ИИ и МО уделено достаточно много внимания в ряде исследований. Выделяются основные проблемы: нарушение работоспособности технического и программного обеспечения, распространение информационного оружия, непрерывное усложнение информационных и коммуникационных систем, возможность концентрации информационных средств в руках небольшой группы собственников, использование во вред информационных данных, манипулирование сознанием, использование технологического воздействия на психическую деятельность.

В списке перечисленных проблем чётко просматриваете группа тех, которые бытуют в истории человечества от формации к формации. Это нападение, захват, нанесение вреда, манипулирование, использование достижений для истребления друг друга. Историю наполняют захватнические войны, колонизации, порабощения, истребления. Из формации в формацию человечество переносит груз тех же проблем и вместе с техническими достижениями для улучшения качества жизни, эти проблемы остаются и только переходят на новый уровень развития.

Переходя от одного этапа развития к другому, меняя формации и способы государственного управления, человечество независимо от строя, нации и религии стремится к улучшению качества жизни. Качество жизни проявляется в субъективной удовлетворённости людей самими собой и своей жизнью, а также в объективных характеристиках, свойственных человеческой жизни как биологическому, психическому (духовному) и социальному явлению. Эта тенденция является общей и качество жизни населения определяется следующими направленностями: жизненными потенциалами – общества в целом, социальных групп и отдельных граждан; соответствием характеристик условий и результатов их жизнедеятельности социально-позитивным потребностям, ценностям и целям; внешними возможностями, т.е. свойствами окружающей среды, её объектов и субъектов. Функции всех направленностей должны иметь значимую вероятность достижения целей улучшения качества жизни людского сообщества в целом и в частности отдельных людей, которые хотят это сделать и готовы приложить для этого необходимые усилия.

В связи с этим в развитии и применении ИКТ необходимо осуществлять тот интегральный уровень слияния ИКТ с эволюционным развитием личности и социума, который бы не привёл к тому, что процесс мышления человека будет подавлен услугами технократических средств, которые в прямом смысле могут посадить личность на ментальную «иглу» ИИ и МО, подавляя процесс мышления и интуицию. Вопрос защиты личности от технократической интеллектуализации является одним из важнейших социальных аспектов при внедрении ИКТ. Это и важный аспект образовательной системы.

Следующим важным аспектом в развитии применения ИКТ является тенденция внедрения вычислительной техники следующего поколения, основанной на квантовых принципах.

Серьёзное внимание к данному аспекту может быть основано на том, что биогенетика, лингвогенетика и техногенетика уходят корнями в универсальную инфогенетику и структурированы на её основе, но в разных плоскостях бытия. На квантовом уровне их программная компиляция едина. Трансляция универсальной инфогенетики в различные функциональные уровни с последующим формообразованием биомассивов, языков, технического оборудования и прочего является не более, чем формой субстанционного их представления.

Степени сравнения мощностей мозга, принадлежащего человеческому интеллекту как живому организму с мощностью самой интеллектуальной машины не правомочны. Решение компьютером сложных задач, которые подчинены математическому алгоритмизированию, не является показателем превосходства ИИ. Превосходство заключается в интуитивном реагировании при решении жизненных задач, включающее факторы, которые невозможно компьютеризировать, а также в нахождении той образной сочетаемости при движении мышления с уровня на уровень, которую невозможно алгоритмизировать и отдать в руки машине, какой бы виртуозностью ни обладал математический аппарат. Если вкратце, то ИИ – это попытка воспроизвести процесс возникновения и дальнейшего развития человеческого мозга. Несмотря на все наши усилия, мы до сих пор почти ничего не знаем о том, каким именно образом наш мозг выполняет все те задания, которые отличают нас от остальных видов и делают нас людьми.

Это принадлежит исключительно действию силы, одушевляющей материю и делающей её способной сочетать и соединять, быть разуму рациональным и иррациональным.

Разумность определяется внутренним взвешиванием при установлении взаимосвязей, которое осуществляется через интуитивную и логическую соразмерность, которая происходит в триадном континууме вещественности, квантового процесса и того, что пока наука именует трансцендентным, но что является неотъемлемым включением в моделирующий аспект пространственно-временного континуума бытийности. Подтверждением этому служит явление поэтичности и литературно - художественного творчества. На этом же основан и человеческий фактор, который подчинён интуитивно-чувственной логике и с точки зрения математики необъясним и не может быть алгоритмизирован.

Отдавая дань уважения великим математикам, открывшим законы, делающим заключения, предлагающим гипотезы и строящим прогнозы, и принимая их к сведению, необходимо интуитивно чувствовать меру и грань развития ИКТ, которые бы помогли человечеству совершенствоваться в своём устойчивом развитии. Все средства лишь этому в помощь, но не во вред.

Cписок литературы.

1. Vinge, V. 1993. "The Coming Technological Singularity". http://www- ohan.sdsu.edu/faculty/vinge/misc/singularity.html.

2. А. Новоселов. Технологическая сингулярность как ближайшее будущее человечества. http://andrzej.virtualave.net/Articles/singularity.html

3. Hanson, R. (ed.) 1998. "A Critical Discussion of Vinge's Singularity Concept" ExtropyOnline. http://www.extropy.com/eo/articles/vi.html.

4. Харари Ю. «Sapiens: Краткая история человечества» www.labirint.ru/books/498309

5. Хардиди, С. Internet Definition History [Electronic resource]. –Available at: http://www.hpssociety.info/news/internet-definition-history.html. [Accessed: 01.80.2018].

6. Colors collective , https://www.quantamagazine.org/mathematicians-measure-infinities-find-theyre-equal-20170912/

7. Демидов С. С. «Математические проблемы» Гильберта и математика XX века // Историко-математические исследования. – М. : Янус-К, 2001. – № 41 (6). – С. 84–99.

8. Ben-David, S. Learnability can be undecidable / S. Ben-David, P. Hrubes, S. Moran, A. Shpilka, A. Yehudayoff // Nature Machine Intelligence. – 2019. - №1. – PP. 44-48. – https://doi.org/10.1038/s42256-018-0002-3.