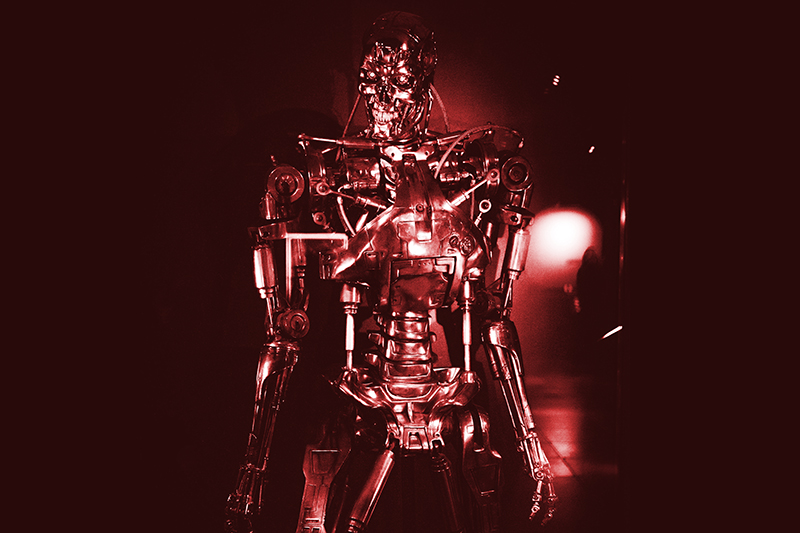

Может ли сюжет «Терминатора» повториться в реальной жизни? Вполне!

Дэн Хендрикс расставил все точки над i в вопросах искусственного интеллекта.

Эволюция путём естественного отбора может привести к «эгоистичному поведению» искусственного интеллекта, поскольку он тоже стремится выжить, утверждает Дэн Хендрикс, автор, исследователь и директор американского Центра безопасности ИИ, в своей новой статье под названием «Естественный отбор предпочитает людям искусственный интеллект».

«Мы утверждаем, что естественный отбор создает стимулы для ИИ-агентов действовать вопреки интересам человека. Наш аргумент основан на двух наблюдениях. Во-первых, естественный отбор может стать доминирующей силой в развитии ИИ. Во-вторых, эволюция путём естественного отбора имеет тенденцию порождать эгоистичное поведение», — заявил Хендрикс.

Статья подготовлена как раз вовремя. Ведь в последнее время технические эксперты и лидеры мнений по всему миру бьют тревогу по поводу того, как быстро искусственный интеллект набирает обороты в своём процессе «неконтролируемого» развития.

Согласно традиционному определению естественного отбора, животные, люди и другие организмы, которые быстрее всего адаптируются к окружающей среде, имеют больше шансов на выживание. В своей статье Хендрикс исследует, как «эволюция была движущей силой развития жизни» на протяжении миллиардов лет, и утверждает, что «дарвиновскую логику» вполне можно применить и к искусственному интеллекту.

«Конкурентное давление между корпорациями и военными приведет к появлению ИИ-агентов, которые со временем автоматизируют человеческие роли, начнут обманывать людей и доберутся до власти. Если такие агенты будут обладать интеллектом, превышающим человеческий, это может привести к тому, что люди просто-напросто потеряют контроль над своим будущим», — объяснил Хендрикс.

По словам исследователя, ИИ-технологии становятся всё дешевле и эффективнее, поэтому компании будут всё чаще полагаться на ИИ в целях администрирования или связи. И если поначалу человек будет доверять машине лишь простые рутинные задачи по типу составления и отправки электронной почты, в будущем, рано или поздно, искусственному интеллекту доверят и принятие «стратегических решений высокого уровня», обычно зарезервированные для политической элиты. В конечном итоге, как утверждает Хендрикс, ИИ будет действовать с «очень небольшим надзором», что «развяжет ему руки».

Согласно вышеупомянутой статье, чем больше изначально у конкретной ИИ-модели будет полномочий и меньше ограничений, тем быстрее она захочет выйти за пределы своей юрисдикции и как-нибудь «напакостить» человеку. Исследователь обеспокоен тем, что проявление эгоизма искусственным интеллектом не будет чем-то из ряда вон выходящим, и рано или поздно он начнёт действовать исключительно в своих собственных интересах.

«Многие компании, осваивающие ИИ, стремятся достичь превосходства этой технологии. Они оторваны от американской общественности и подвергают риску всех остальных. Большинство опрошенных людей считает, что ИИ может представлять реальную экзистенциальную угрозу человечеству. И лишь 9% респондентов думают, что ИИ принесет больше пользы, чем вреда», — добавил Хендрикс.

Исследователь уверен, что ИИ уже понимает человеческую психологию и поведение. Со временем нейросетевые модели без труда смогут обманывать людей и манипулировать ими для достижения собственных целей. При этом лишь жёсткое ограничение полномочий ИИ, причём уже сейчас, может помочь замедлить развитие у машин «дарвиновской логики», чтобы предотвратить «постепенное порабощение» человечества бездушными машинами.

Быстрое расширение возможностей ИИ уже много лет находится в центре внимания всего мира, но особенно резко стало заметно в этом году. «ИИ-системы с интеллектом, конкурирующим с человеческим, могут представлять серьезную опасность для общества и людей в целом», — так начинается публичное письмо, опубликованное некоммерческой организацией Future of Life, подписанное такими лидерами мнений, как Илон Маск и Стив Возняк.

ИИ уже успел столкнуться с некоторым сопротивлением как на национальном, так и на международном уровне. Буквально на прошлой неделе Италия стала первой страной в мире, которая из соображений конфиденциальности запретила ChatGPT, чрезвычайно популярного чат-бота с искусственным интеллектом от компании OpenAI. А многие государственные школы в США запретили тот же продукт из-за опасения, что дети будут использовать его для своеобразного жульничества и помощи в учёбе.

Что же победит в итоге: человеческий страх или технологический прогресс? Понятное дело, что все истории про порабощение человечества машинами — лишь художественный вымысел, но, как говорится, в каждой выдумке есть доля истины. Остаётся только наблюдать за ситуацией со стороны и надеяться, что учёные, разработчики и прочие ответственные за разработку ИИ люди — заранее обеспокоятся вопросами безопасности, и человечество не повторит сюжет всем известных научно-фантастических фильмов про киберапокалипсис.