ИИ против ИИ: новый фронт борьбы с фишингом

Эксперты рассказали, как хакеры используют ИИ для создания фишинговых писем, и как ИИ защитит от фишинга.

Фишинговые атаки, которые в прошлом году стали самым распространенным способом вымогательства денег у организаций, становятся все сложнее обнаружить. По данным ИБ-компании Abnormal Security, злоумышленники используют ИИ для создания поддельных электронных писем, имитирующие письма от известных компаний.

Согласно отчёту Abnormal Security, с помощью ChatGPT и других больших языковых моделей (LLM) мошенники могут составлять убедительные тексты для социальной инженерии, которые не содержат синтаксических, орфографических и грамматических ошибок, ошибок в форматировании и адресах электронной почты.

Abnormal Security использовала свои собственные модели ИИ, чтобы определить, что некоторые фишинговые письма, отправленные ее клиентам, скорее всего были сгенерированы ИИ. Специалисты компании заявили, что они всё ещё проводят полный анализ, чтобы понять масштаб проблемы со сгенерированными ИИ фишинговыми письмами. Кроме того, эксперты Abnormal отмечают рост количества атак с использованием ИИ в последнее время.

Abnormal использовала большие языковые модели с открытым исходным кодом для анализа вероятности того, что каждое слово в электронном письме может быть предсказано с учетом контекста слева от слова. По словам компании, если слова и термины в письме явно соответствуют тому, что написала бы нейросеть, а не человек, то такое письмо можно классифицировать как сгенерированное ИИ.

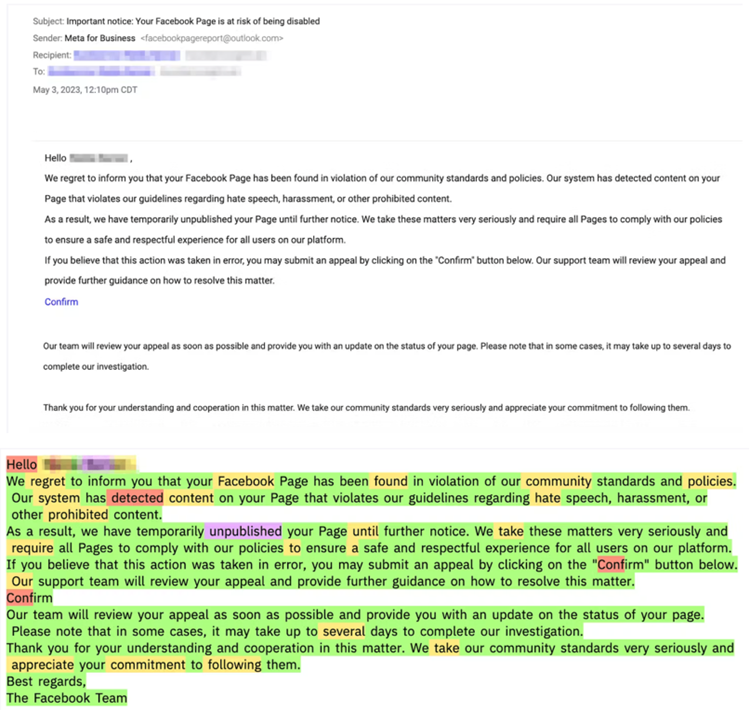

Анализ фишингового письма: зеленые слова оцениваются как наиболее соответствующие ИИ (входят в 10 лучших предсказанных слов), а желтые слова входят в 100 лучших предсказанных слов

Новая тактика фишинга заключается в подделке официальных уведомлений Facebook* о том, что пользователь нарушил правила сообщества и что его страница была заморожена. Затем пользователя просят перейти по ссылке и подать апелляцию, которая ведет на фишинговую страницу для сбора учетных данных. Кампания дает киберпреступникам доступ к странице пользователя в Facebook* или возможность продать учетные данные жертвы в даркнете.

Текст в поддельных уведомлениях Facebook почти идентичен написанию Meta for Business. Это свидетельствует о том, что менее опытные злоумышленники смогут легко избежать инструментов защиты против фишинга.

Опасность ИИ в кибератаках заключается в том, что он позволяет хакерам создавать все более сложный контент, повышая вероятность того, что жертва поверит и перейдет по ссылке или выполнит инструкции.

По словам экспертов, ИИ также может быть использован для индивидуализации писем. Например, мошенники могут добавить в письмо фрагменты истории переписки или содержание профиля LinkedIn своей жертвы.

Как бороться с фишинговыми атаками на основе ИИ

В отчете специалисты Abnormal Security предложили организациям внедрить инструменты защиты на основе ИИ, которые могут обнаруживать высококачественные сгенерированные письма, которые почти невозможно отличить от настоящих. Компании также должны различать, какое письмо настоящее и какое фишинговое.

Организации также должны придерживаться хорошей кибергигиены, включая внедрение непрерывного обучения по вопросам безопасности, чтобы обеспечить бдительность сотрудников по поводу рисков, связанных с компрометацией корпоративной почты. Кроме того, внедрение многофакторной аутентификации (МФА, MFA) позволит компании ограничить дальнейший ущерб в случае компрометации.

* Компания Meta и её продукты (Instagram и Facebook) признаны экстремистскими, их деятельность запрещена на территории РФ.