Эйнштейн заговорил: китайский OmniHuman-1 выходит на новый уровень реалистичности

Голос, мимика, жесты: ByteDance представила главного конкурента Sora.

Китайская технологическая компания ByteDance, разработчик TikTok, представила новую нейросеть OmniHuman-1. Этот мультимодальный искусственный интеллект способен создавать детализированные видеоролики людей на основе фото и аудио. По заявлению разработчиков, модель значительно превосходит существующие методы генерации видео, синхронизируя движения, мимику и голос.

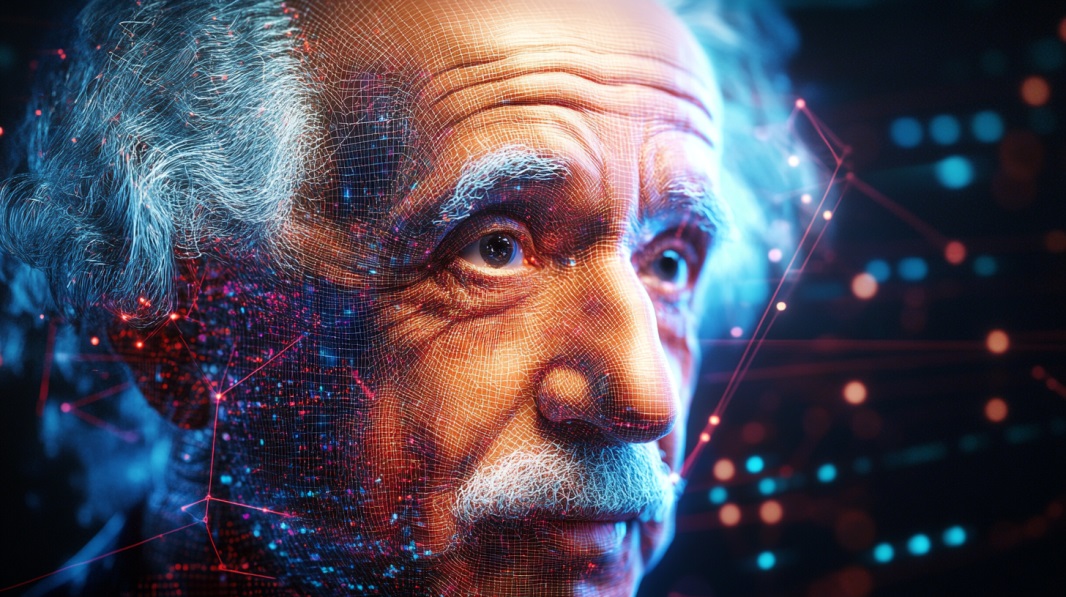

OmniHuman-1 может формировать видео, в которых человек говорит, поет или двигается так, словно он действительно присутствует в кадре. Демонстрационные ролики уже привлекли большое внимание в сети. Один из наиболее обсуждаемых примеров — 23-секундное видео с Альбертом Эйнштейном, который будто бы произносит речь. Некоторые специалисты называют результат «шокирующе реалистичным» и отмечают, что технология приближает deepfake-видео к уровню, при котором их сложно отличить от реальных записей.

ByteDance пока не раскрыла деталей о возможном публичном релизе OmniHuman-1, однако технология уже демонстрирует потенциал для множества приложений — от создания цифровых аватаров до автоматизированного дубляжа видео. В технической публикации исследователи компании описали новый метод обучения модели, объединяющий текстовые, аудио- и визуальные данные. Такой подход помогает улучшить масштабируемость генеративных алгоритмов и позволяет создавать видео с различными пропорциями тела и форматом кадра — от крупных планов лица до полноразмерных сцен.

Модель способна точно передавать выражение лица, движение губ и жесты, синхронизируя их с аудиофайлом. Один из тестовых примеров — видео с человеком, читающим лекцию в стиле TED Talk, где движения рук и артикуляция совпадают настолько точно, что видео выглядит как живое выступление.

Развитие OmniHuman-1 идет на фоне ужесточения ограничений со стороны США в отношении китайских технологий в области искусственного интеллекта. Тем не менее, китайские компании продолжают активно развивать генеративные модели. ByteDance уже представила несколько платформ для видео-генерации, включая Jimeng AI, в которую входят модели PixelDance и Seaweed. Последние обновления Jimeng AI улучшили синхронизацию изображений с видео, делая сгенерированные сцены более «живыми».

Помимо ByteDance, в этом направлении работают и другие китайские компании. Конкуренцию им составляют Kuaishou Technology с приложением Kling, а также стартапы Zhipu AI, Shengshu Tech и MiniMax. Эти разработки показывают, что Китай продолжает наращивать присутствие в сфере генеративного искусственного интеллекта, несмотря на технологические санкции.