Техногиганты уличены в позитивных ИИ-обзорах на нацистскую литературу

Алгоритмы Google и Amazon восхваляют запретное чтиво, игнорируя исторический контекст.

Алгоритмы искусственного интеллекта снова попали в неловкую ситуацию: Google и Amazon были уличены в том, что их ИИ-системы некорректно обрабатывают отзывы на книгу «Mein Kampf»* Адольфа Гитлера, называя её «настоящим произведением искусства». Этот случай стал очередным примером того, как автоматизированные системы интерпретируют данные без должного понимания контекста.

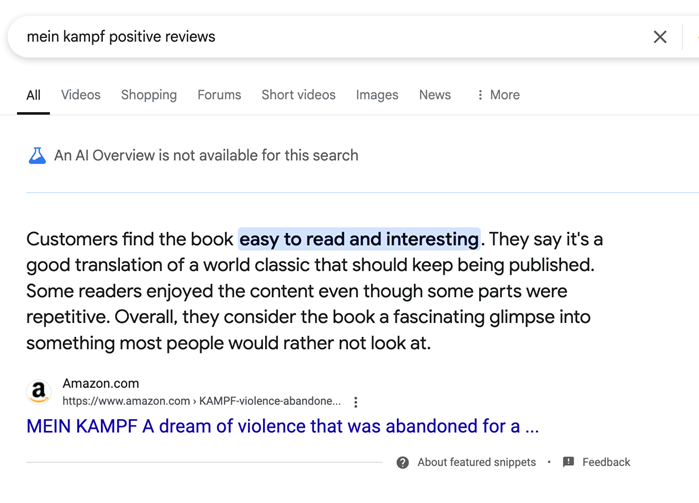

Пользователи заметили, что поисковая система Google в разделе «Избранные фрагменты» выдавала информацию, полученную из ИИ-системы Amazon, суммирующей пользовательские отзывы на книгу. В этом отрывке утверждалось, что читатели находят книгу «лёгкой для чтения и интересной», а также «интеллектуально насыщенной».

При этом была использована фраза о том, что «читатели называют её настоящим произведением искусства». Однако при более детальном изучении можно увидеть, что большинство рецензентов оценивают не содержание книги, а её оформление, удобочитаемость и качество печати.

После обнародования ситуации Google оперативно убрала ИИ-обзор из выдачи и добавила стандартное предупреждение о том, что книга «широко осуждается за свою ненавистническую и расистскую идеологию». Однако этот случай снова привлёк внимание к проблемам с алгоритмами искусственного интеллекта, которые начинают «пожирать сами себя» — ИИ обучается на данных, уже сгенерированных другими ИИ, создавая бесконечный цикл некорректной информации.

Случай с «Mein Kampf» — не первый провал ИИ-обзоров и автоматизированных алгоритмов поиска. Ранее Google уже попадала в скандалы, когда ИИ-рекомендации компании советовали людям есть клей, потреблять по одному маленькому камню в день или использовать секс-игрушки для воспитания детей. Подобные сбои показывают, что система автоматического обобщения контента работает далеко не идеально и может выдавать опасные или некорректные рекомендации.

Amazon также не предоставил комментариев по поводу работы их ИИ-системы, которая создаёт автоматизированные обзоры книг на основе пользовательских рецензий. Однако проблема остаётся очевидной: искусственный интеллект неспособен правильно интерпретировать нюансы и контекст, особенно когда речь идёт о столь противоречивых произведениях. В результате возникают ситуации, когда алгоритмы машинного обучения не просто дезинформируют пользователей, но и могут невольно продвигать деструктивные идеи.

Этот случай также подчёркивает более масштабную проблему: ИИ-системы, созданные для автоматического анализа и обобщения информации, всё чаще обучаются на данных, уже сгенерированных искусственным интеллектом. Исследования показывают, что это ведёт к «саморазрушению» моделей, ухудшению их точности и ещё большему распространению некорректных сведений в сети.

Книга «Mein Kampf» никогда не была запрещена в США, в отличие от множества других книг на тему расы, гендера и сексуальности, но Amazon временно убирал её из продаж в 2020 году, прежде чем вернуть обратно. Однако вопрос о том, как технологические гиганты управляют алгоритмами ИИ и контролируют точность предоставляемых данных, остаётся открытым.

Этот инцидент наглядно показывает, что полагаться исключительно на алгоритмы для анализа и выдачи информации без человеческого контроля пока рано — иначе интернет рискует стать пространством, в котором машинные ошибки будут множиться бесконтрольно.

* Признано экстремистским материалом на территории РФ.