Голливуд горит. Миллионы в кармане. Всё плохо. Но красиво. Но фейк

Instagram не видит проблему, потому что видит деньги.

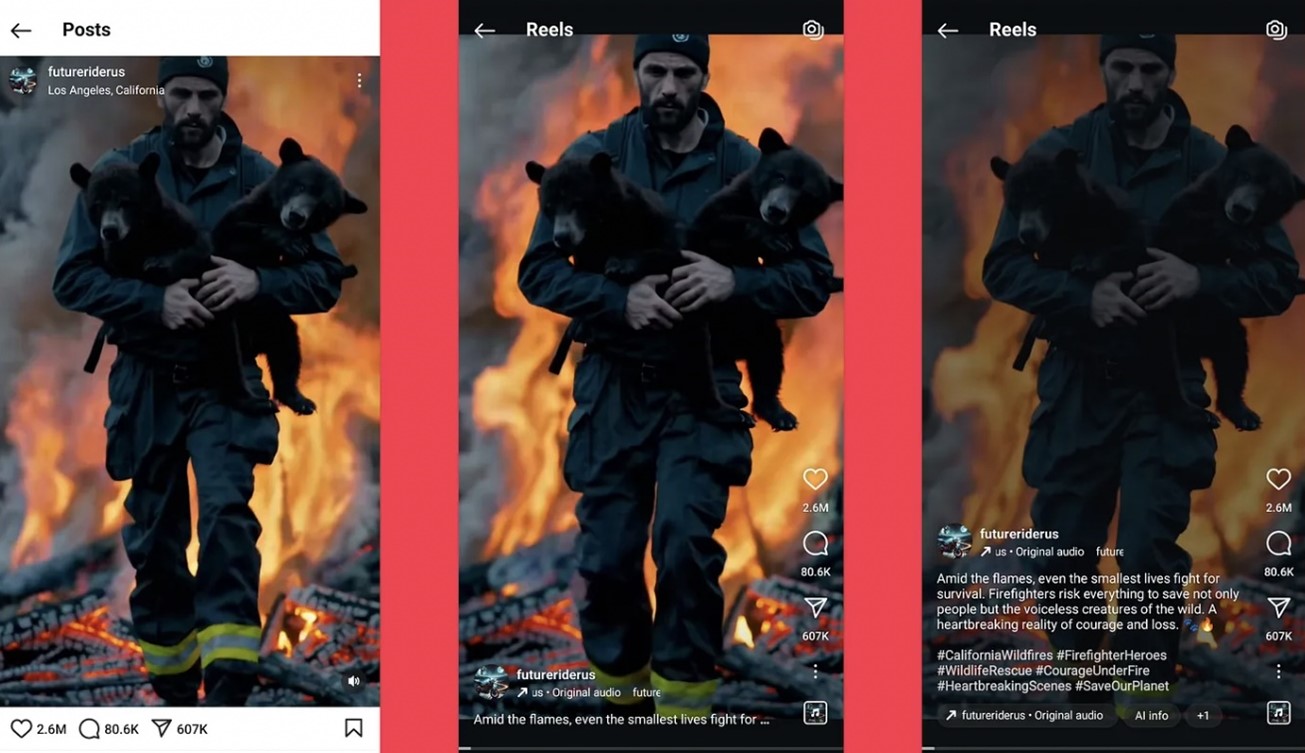

В начале января пользователи Instagram* заметили необычные ролики: знаменитые буквы Hollywood охвачены пламенем, а в следующем видео пожарные спасают детёнышей животных. Картинки выглядят жутко правдоподобно — но всё это фейк. Видео были созданы нейросетями, и несмотря на свою вымышленность, они собрали миллионы просмотров и принесли автору доход.

За этим контентом стоит аккаунт FutureRiderUS , который изначально публиковал ролики с мотоциклами на фоне футуристических пейзажей. Они набирали по 20–30 тысяч просмотров. Но всё изменилось, когда автор опубликовал первый ролик с горящим Голливудом — он собрал миллион просмотров. Следом вышло видео с пожарными и животными — уже 23 миллиона просмотров, 78 тысяч комментариев и 2,5 миллиона лайков. Самое популярное видео на данный момент – пожарный выносит животное из горящего леса. Видео набрало более 45 миллионов просмотров.

Скриншот одного из ИИ-видео (FutureRiderUS)

Сколько можно заработать на таком хайпе? Точные суммы неизвестны, но, по оценкам блогеров, Instagram выплачивает от $100 до $120 за каждый миллион просмотров Reels. FutureRiderUS за сутки набрал примерно 94 миллиона просмотров на нескольких вирусных видео.

Примеры видео профиля FutureRiderUS (FutureRiderUS)

После этого успеха аккаунт стал активно тестировать, какие видео заходят лучше. Сначала были кадры с героями-спасателями, затем — просто животные, бегущие от огня, а потом и вовсе странные сцены: человек с дымом из-под куртки, енот, которого будто специально толкают обратно в пламя. Некоторые ролики становились откровенно абсурдными, но просмотры росли.

Оказалось, что многие зрители даже не осознают, что эти видео — не настоящие. Некоторые злорадствуют, кто-то возмущается, но третья группа зрителей искренне считает, что такие кадры нужны для «поднятия осведомлённости» — даже если они вымышленные. Именно на этот аргумент ссылается и автор аккаунта. Он заявил, что хотел показать настоящую трагедию через «искусство», созданное ИИ.

Однако это объяснение не совпадает с реальностью. Аккаунт открыто продаёт курс по созданию вирусных ИИ-видео за $20. В рекламном посте утверждается, что владелец FutureRiderUS получил 285 миллионов просмотров за месяц, а курс поможет повторить его успех. Курс состоит из PDF-файла и скринкаста, где за 7 минут показывается весь процесс: найти тренд, ввести запрос в нейросеть, наложить музыку, выложить видео. И повторять это несколько раз в день.

Сам автор признался, что начал этим заниматься в декабре, и он из России. По его словам, результат превзошёл ожидания — видео залетают, курс продаётся. На вопросы о недостоверности видео он отвечает просто: «Всё по правилам». Действительно, Instagram автоматически ставит метку «AI Info», но увидеть её можно только при открытии расширенного описания, а не в самом ролике. Это делает раскрытие происхождения контента практически незаметным.

Метка AI Info (FutureRiderUS)

Meta* не даёт официального ответа на вопрос, достаточно ли такой маркировки. Но в публичных заявлениях компания дала понять, что не планирует блокировать такие видео — наоборот, их будет становиться больше. И пока платформы позволяют подобный контент и платят за него, у авторов нет причин останавливаться.

Несколько дней спустя после вирусных успехов FutureRiderUS сменил тематику. На фоне обсуждений прекращения огня в Газе автор выпустил ролик с плачущими детьми и флагом Палестины. В описании — расплывчатый текст о человечности и страданиях. Но публика не откликнулась: видео провалилось, не набрав и 10 тысяч просмотров. И тут же был опубликован новый ролик — медведь ест мёд.

Но есть одна вещь, которую нельзя подделать даже с помощью самой продвинутой нейросети — это доверие. Пока платформы вроде Instagram поощряют публикацию фейков и минимально обозначают их искусственное происхождение, пользователь остаётся безоружным перед контентом, созданным ради кликов. Алгоритмы и авторы зарабатывают на эмоциях, будь то ужас, сочувствие или слёзы — особенно если в кадре плачет ребёнок или горит знакомая достопримечательность. Всё превращается в материал для тестов: что сегодня лучше сработает — сова на фоне пепелища или флаг на руинах?

В этой гонке за вниманием побеждает не правда, а яркость. И если ничего не изменится, нас ждёт контент, где граница между реальностью и вымыслом окончательно исчезнет. Вопрос лишь в том, готовы ли платформы взять на себя хоть какую-то ответственность за происходящее — или всё так и останется в зоне «AI Info», которую никто не видит?

* Компания Meta и её продукты (включая Instagram, Facebook, Threads) признаны экстремистскими, их деятельность запрещена на территории РФ.