Чат-бот в службе поддержки «опозорил» компанию-разработчика популярного ПО

ИИ врал так правдиво, что все ему поверили. Теперь фирма массово теряет клиентов.

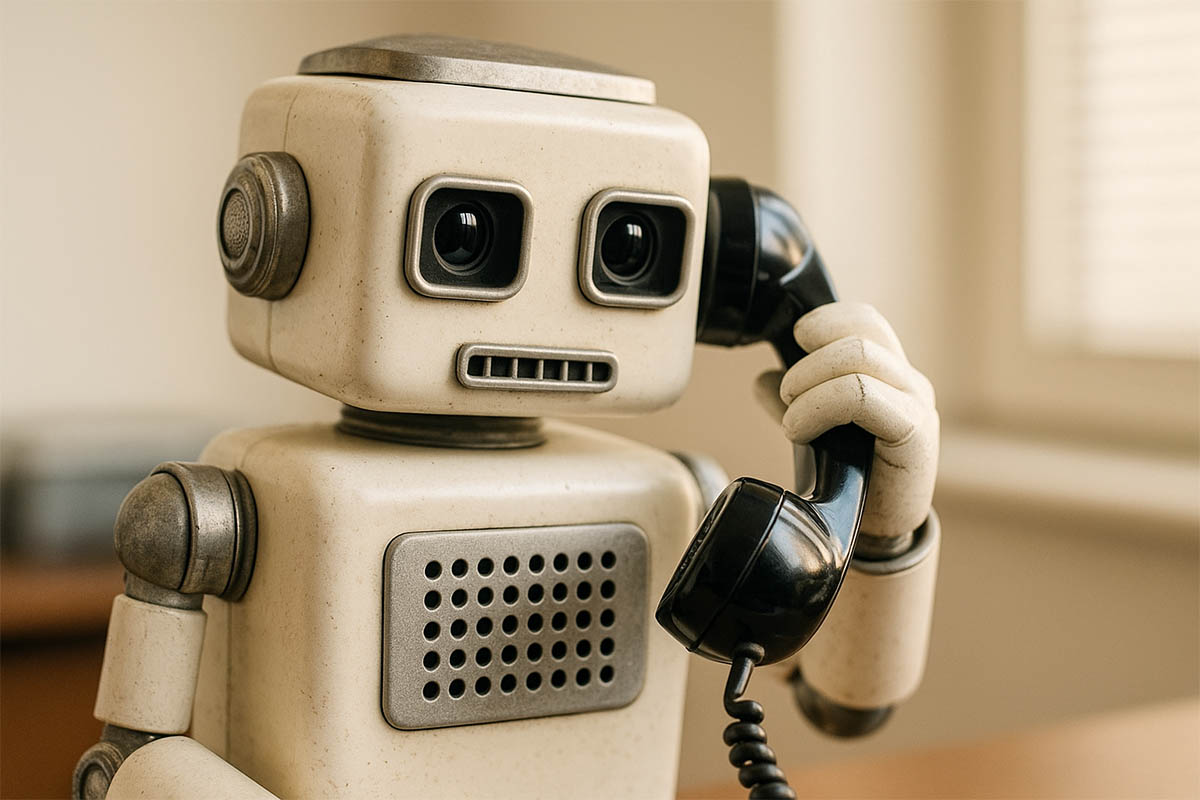

Компания Cursor, разработчик популярного редактора кода с поддержкой ИИ, оказалась в центре скандала после того, как её автоматический помощник по имени Sam выдумал несуществующее правило, касающееся условий использования программного обеспечения, вызвав волну недовольства пользователей и отмен подписок.

Ситуация началась с того, что один из разработчиков заметил: при переходе между устройствами с запущенным Cursos происходил автоматический выход из системы, что сбивало привычный рабочий процесс. Когда пользователь обратился в техподдержку, он получил официальный на вид ответ — использовать Cursor можно только на одном устройстве, а для второго требуется отдельная подписка. На первый взгляд — обыкновенная практика, которой придерживаются многие продукты по подписке. Проблема лишь в том, что такого правила никогда не существовало, а сообщение придумал чат-бот.

На форумах Reddit и Hacker News вскоре появились возмущённые посты, в которых разработчики заявляли об отказе от подписки на Cursor и критиковали компанию за ограничение кроссплатформенного доступа. Именно возможность работать с несколькими устройствами подряд — основа рабочих процессов для многих программистов.

Ответ чат-бота «Sam» выглядел настолько убедительно, что пользователи приняли его за официальную позицию компании. В реальности же это было проявлением «галлюцинирования» — явления, когда ИИ, не зная точного ответа, додумывает правдоподобную информацию.

В итоге под Reddit-постом начали появляться заявления об отмене подписок, а оригинальный автор даже сообщил, что его компания полностью отказалась от Cursor. Через несколько часов представитель Cursor попытался исправить ситуацию, написав на том же форуме, что никакой политики ограничений на количество устройств не существует, а сообщение сгенерировано ИИ без проверки человеком.

Это не первый случай, когда ИИ в клиентском сервисе приводит к проблемам. В начале 2024 года авиакомпания Air Canada также столкнулась с судебным разбирательством после того, как её чат-бот выдумал политику возврата билетов, которой не существовало. Тогда компания попыталась снять с себя ответственность, заявив, что бот действует как «отдельное юридическое лицо», но суд признал её виновной.

В отличие от Air Canada, Cursor признала ошибку. Один из основателей компании, Майкл Труэлл, извинился за инцидент и объяснил, что проблема с выходом из аккаунта была связана с обновлением backend-системы безопасности. Пользователю, которому ИИ сообщил вымышленную политику, вернули деньги за подписку.

Однако это решение не остановило обсуждения. Многие пользователи остались недовольны тем, что ответ ИИ не был обозначен как автоматический. Некоторые подчеркнули, что использование имени и стилистики реального человека создаёт впечатление общения с живым сотрудником, что воспринимается как умышленное введение в заблуждение. В связи с этим, теперь в компании решили маркировать все сообщения, сгенерированные ИИ, чтобы избежать путаницы.

Инцидент стал ярким примером того, как легко ИИ может причинить реальный ущерб бизнесу, особенно если используется на передовой линии общения с клиентами. В ситуации с Cursor ирония заключается ещё и в том, что компания сама разрабатывает инструменты на базе ИИ, а значит, особенно уязвима к ошибкам, связанным с «галлюцинациями» модели.