Символы-призраки в ChatGPT: случайная разметка или тайная функция OpenAI?

Обычный текст — не такой уж и обычный, если знать, где искать.

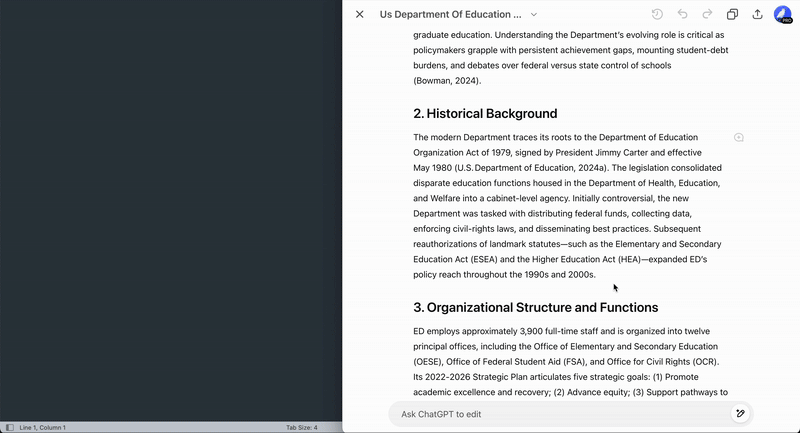

Команда исследователей из Rumi обратила внимание на то, что в более новых моделях GPT‑o3 и GPT‑o4 mini при генерации длинных ответов случайно появляются специальные невидимые символы — в основном Narrow No‑Break Space, которые внешне не отличаются от обычных пробелов, но имеют другой код. При внимательном анализе в текстовых редакторах вроде Sublime Text или онлайн‑инструментах для просмотра символов эти «метки» выдают себя постоянным, повторяющимся рисунком — что наводит на мысль о намеренной разметке сгенерированного текста.

Однако после публикации результатов с Rumi связались в OpenAI и уточнили, что никакой «водяной метки» здесь нет: эти неприметные символы появляются лишь из‑за особенностей масштабного обучения с подкреплением. Компания не планирует делать официального анонса, чтобы не снижать эффективность возможных способов обнаружения машинного текста, но они и сами признают, что подобные символы могут раздражать пользователей и вскоре будут устранены.

Для многих студентов, которым до конца мая открыт бесплатный доступ к ChatGPT, эта история приобретает практический смысл: невнимательно скопированный материал из ChatGPT может быть обнаружен преподавателями, если те будут проверять наличие невидимых пробелов. С другой стороны, как только станет известно о существовании таких «пробелов‑меток», достаточно простой операции «найти и заменить», чтобы полностью лишить текст этой особенности и обойти проверку.

Метод внедрения невидимых символов воспринимается экспертами скорее как временная мера. Он уступает более надёжным способам анализа авторства и легко нейтрализуется. Вместо того чтобы полагаться на тех, кто может просто почистить текст, команда Rumi предлагает сместить акцент в образовании на сам процесс написания: фиксировать промежуточные версии работ, организовывать контрольные точки и коллективные рецензии, а также формировать у студентов умение осознанно пользоваться ИИ и отражать свой вклад в каждой части работы.

В долгосрочной перспективе такие практики помогут не столько ловить тех, кто пытается применить ChatGPT для выполнения домашних заданий, сколько научить учащихся критически относиться к собственному тексту и понимать, как искусственный интеллект может стать инструментом, а не заменой их интеллектуальным усилиям.